Khám phá code combat rift mới nhất và cách nhập code combat rift

Share code

September 7, 2023

Bạn đã nghe về Code Combat Rift mới nhất chưa? Nếu bạn muốn trải nghiệm trò chơi nhập code hấp…

Cập nhật Code Cửu Thiên Mobile mới nhất và hướng dẫn dùng code

Share code

September 7, 2023

Code Cửu Thiên Mobile mới nhất – Cửu Thiên Mobile là một trò chơi nhập vai nổi tiếng do NPH…

Tổng hợp Code Cửu Mộng Tiên Vực mới nhất và cách sử dụng code

Share code

September 7, 2023

Code Cửu Mộng Tiên Vực mới nhất – Cửu Mộng Tiên Vực Mobile là một trò chơi nhập vai MMORPG…

Tổng hợp code Đại Lộ Danh Vọng mới nhất 2023 và cách nhập code

Share code

September 7, 2023

Bạn đã biết về code Đại Lộ Danh Vọng mới nhất 2023 và cách nhập code chưa? Nếu bạn là…

TỔNG HỢP CODE ĐẠI HOANG PHONG THẦN LỤC MỚI NHẤT NĂM 2023

Share code

September 7, 2023

Bạn đã bao giờ tò mò về những mã code Đai Hoang Phong Thần Lục ? Hãy cùng triple-hearts khám…

TỔNG HỢP CODE ĐẠI HIỆP TRUYỆN MỚI NHẤT NĂM 2023 VÀ CÁCH NHẬP CODE

Share code

September 7, 2023

Bạn có muốn khám phá những code đại hiệp truyện mới nhất? Từ những mã này, bạn có thể nhận…

Tổng hợp Code Đại Chúa Tể mới nhất năm 2023 và cách nhập code

Share code

September 7, 2023

Bạn đang quan tâm đến vấn đề code Đại Chúa Tể mới nhất năm 2023 và cách nhập code? Code…

Tổng Hợp Code Đại Chiến Tân Thế Giới Mobile Mới Nhất Và Cách Nhập

Share code

September 7, 2023

Bạn muốn tìm kiếm những mã code đại chiến tân thế giới mobile mới nhất? Hãy đến với bài viết…

Tổng hợp Code Đại Chiến Tân Thế Giới mới nhất năm 2023

Share code

September 7, 2023

Bạn đang tìm kiếm các mã code Đại Chiến Tân Thế Giới mới nhất năm 2023? Hãy cùng triple-hearts khám…

TỔNG HỢP CODE ĐẠI CHIẾN SAMURAI MỚI NHẤT NĂM 2023

Share code

September 7, 2023

Bạn đang tìm kiếm thông tin về code đại chiến Samurai mới nhất năm 2023? Đúng chỗ rồi! Trong thế…

Tổng hợp code Đại Chiến Nhẫn Giả mới nhất năm 2023 và cách nhập

Share code

September 7, 2023

Bạn là một người yêu thích game Đại Chiến Nhẫn Giả? Bạn không muốn bỏ lỡ bất kỳ mã code…

TỔNG HỢP CODE DA HOOD MỚI NHẤT

Share code

September 7, 2023

Bạn đã sẵn sàng để khám phá những mã code Da Hood mới nhất? Đừng bỏ qua cơ hội tận…

Bạn có muốn khám phá các code cyber fantasy tân giới viễn tưởng mới nhất năm 2023? triple-hearts đã tổng…

Hướng dẫn nhập code Chrono Piece mới nhất một cách đơn giản

Share code

September 7, 2023

Nếu bạn là một fan của trò chơi Roblox và đặc biệt là trò chơi Chrono Piece, thì bạn không…

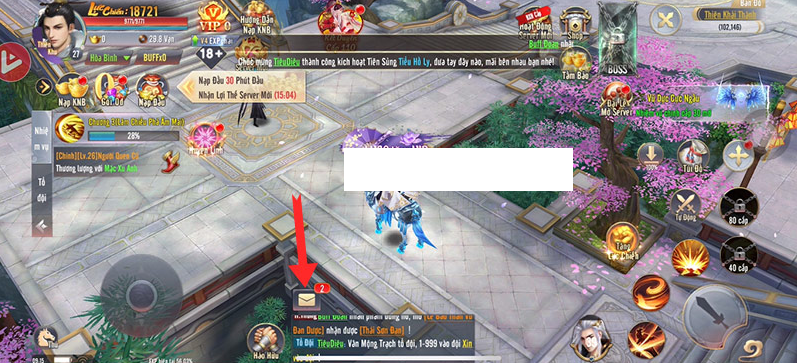

Khám phá code Cực loạn 3q mới nhất và cách nhập code Cực loạn 3q

Share code

September 7, 2023

Bạn đã muốn khám phá mã code mới nhất của Code Cực loạn 3Q mới nhất và muốn biết cách…

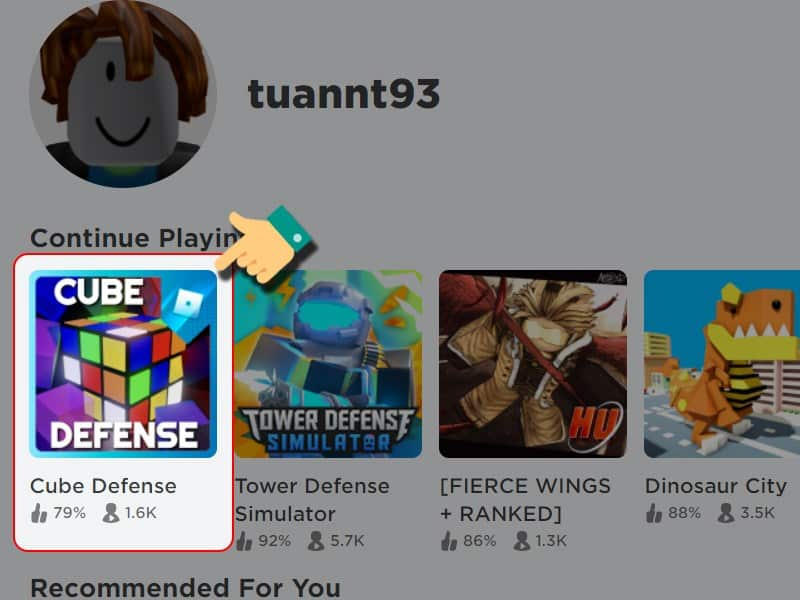

Khám phá code cube defense mới nhất và cách nhập code cube defense

Share code

September 7, 2023

Bạn muốn khám phá code cube defense mới nhất và muốn biết cách nhập code cube defense? Code Cube Defense…

Khám phá code crystal magnet simulator mới nhất và cách nhập code crystal magnet simulator

Share code

September 7, 2023

Bạn có muốn khám phá code simulator mới nhất về nam châm biến đổi công nghệ và cách nhập mã…

Khám phá code crazy boom mới nhất và cách nhập code crazy boom

Share code

September 7, 2023

Bạn có muốn khám phá code Crazy Boom mới nhất và biết cách để nhập code Crazy Boom không? Crazy…

Khám phá code Cờ võ hiệp mới nhất và cách nhập code Cờ võ hiệp

Share code

September 7, 2023

Bạn muốn khám phá code Cờ võ hiệp mới nhất và để biết cách nhập code Cờ võ hiệp? Code…

Khám phá code counter side mới nhất và cách nhập code counter side

Share code

September 7, 2023

Bạn muốn khám phá code counter side mới nhất và biết cách nhập code counter side? Code counter side là…

Khám phá code cookie run ovenbreak mới nhất và cách nhập code cookie run ovenbreak

Share code

September 7, 2023

Bạn có muốn khám phá code cookie run ovenbreak mới nhất của trò chơi Cookie Run Ovenbreak và biết cách…

Khám phá code cookie run kingdom mới nhất và cách nhập code cookie run kingdom

Share code

September 7, 2023

Bạn đã nghe về Code Cookie Run Kingdom mới nhất chưa? Nếu bạn muốn khám phá những code mới nhất…

Tìm và nhận các mã code Chrono Legacy mới nhất

Share code

September 7, 2023

Chúng tôi sẽ cung cấp danh sách mã code Chrono Legacy mới nhất để nhận phần thưởng. Bài viết cũng…

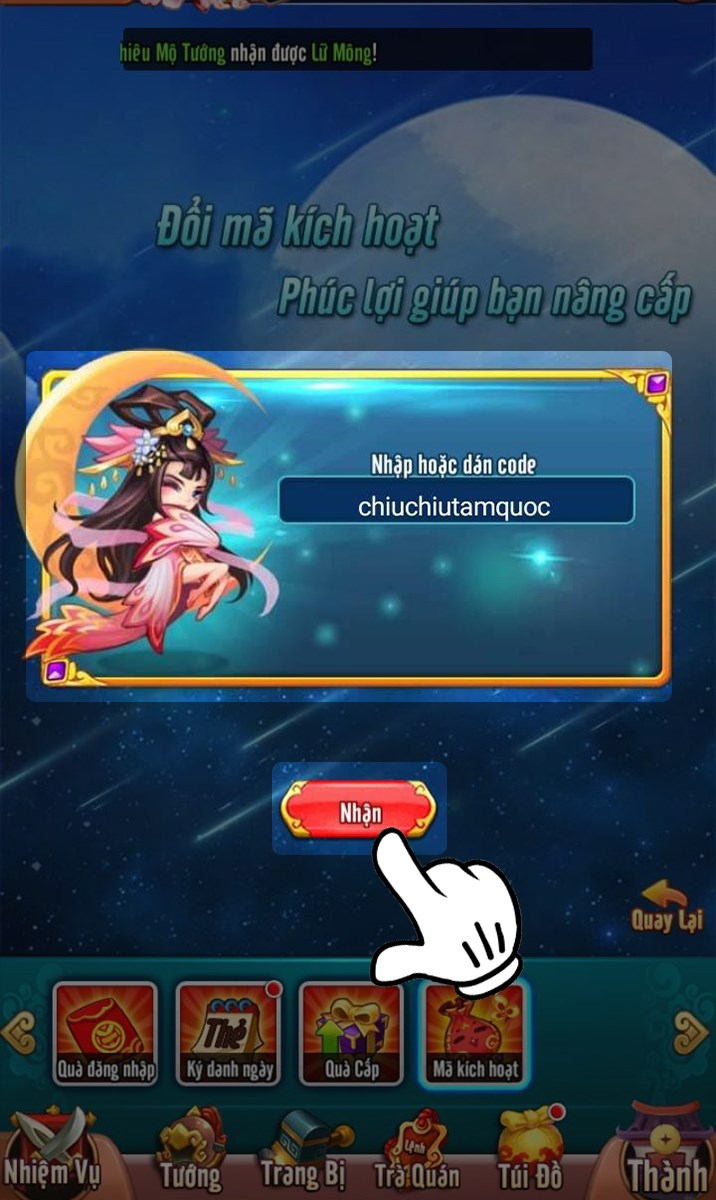

Tổng hợp mã code Chiu Chiu Tam Quốc mới nhất và cách sử dụng

Share code

September 7, 2023

Danh sách mã code Chiu Chiu Tam Quốc mới nhất đã công bố. Để nhập mã code, bạn cần hoàn…

Mã code ChimeraLand mới nhất và phần thưởng tương ứng

Share code

September 7, 2023

Bạn đang tìm kiếm những cách để nâng cao khả năng chiến đấu và tích luỹ tài nguyên trong thế…

Làm cách nào để tìm mã code Chiến Vương Tam Quốc mới nhất?

Share code

September 7, 2023

Bạn đang chơi game Chiến Vương Tam Quốc và muốn nhận được nhiều phần thưởng hấp dẫn? Bài viết này…

Tổng hợp các code Chiến Tướng Tam Quốc mới nhất 2023

Share code

September 6, 2023

Nếu bạn là fan của game Chiến Tướng Tam Quốc, hãy chuẩn bị sẵn sàng với những mã code Chiến…

Tìm hiểu về Code Chiến Thần Thức Tỉnh mới nhất và nhận quà hấp dẫn

Share code

September 6, 2023

Bạn đã từng nghe nói về Code Chiến Thần Thức Tỉnh mới nhất chưa? Đó là những mã quà tặng…

Những mã code Chiến Thần Kỷ Nguyên mới nhất và hướng dẫn sử dụng

Share code

September 6, 2023

Bạn đang chơi game Chiến Thần Kỷ Nguyên và đang tìm kiếm các mã code Chiến Thần Kỷ Nguyên mới…

Tìm hiểu về code combat warriors mới nhất hiện nay

Share code

September 6, 2023

Code Combat Warriors mới nhất là một tựa game nhập vai mới trên Roblox thu hút sự quan tâm của…

Cập nhật Code Cửu Dương Truyền Kỳ 2 Mobile mới nhất và cách sử dụng code

Share code

September 6, 2023

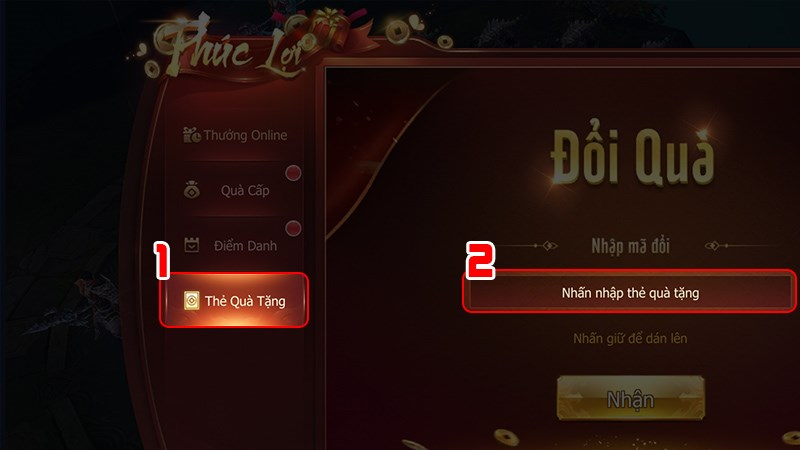

Code Cửu Dương Truyền Kỳ 2 Mobile mới nhất – Nhập vai vào thế giới võ học cổ đại và…

Tổng hợp Code Cửu Âm Chân Kinh Mới Nhất 2023 và cách sử dụng code

Share code

September 6, 2023

Bạn muốn tìm hiểu về Tổng hợp Code Cửu Âm Chân Kinh mới nhất? Cửu Âm Chân Kinh là một…

Cập nhật Code Cursed Bride A Gothic Fantasy mới nhất hiện nay và hướng dẫn nhận Code

Share code

September 6, 2023

Bạn đang tìm kiếm về các code Cursed Bride A Gothic Fantasy mới nhất? Cursed Bride: A Gothic Fantasy là…

Tổng hợp Code Cuộc Chiến Sinh Tồn mới nhất và hướng dẫn dùng code

Share code

September 6, 2023

Mã Code Cuộc Chiến Sinh Tồn mới nhất do NPH GGames phát hành đã sẵn sàng mang đến những phần…

Tổng hợp Code Cung Đình Kế Mới nhất và cách dùng code

Share code

September 6, 2023

Bạn đang tìm kiếm những Code Cung Đình Kế Mới nhất? Trải nghiệm cuộc sống trong cung đình, khám phá…

Code cổ long kiếm Mới Nhất – Cách nhập code

Share code

September 6, 2023

Khi bạn tham gia Cổ Long Kiếm, bạn sẽ có cơ hội trở thành một trong những nhân vật Thần…

Tổng hợp code cổ kiếm mobile 3D Mới Nhất năm 2023 – Cách nhập code

Share code

September 6, 2023

Cổ kiếm Mobile là một tựa game kiếm hiệp và tu tiên hấp dẫn, với đồ họa 3D tuyệt đẹp.…

Tổng hợp code coins hero simulator Mới Nhất năm 2023

Share code

September 6, 2023

Muốn trở thành siêu anh hùng và kiếm được nhiều xu trong trò chơi “Coins Hero Simulator” phiên bản mới…

Tổng hợp Mã code animiya afk epic battles Mới Nhất và Hướng dẫn nhập mã code

Share code

September 6, 2023

Bạn đang đọc bài viết Tổng hợp Mã code animiya afk epic battles Mới Nhất và Hướng dẫn nhập mã…

Tổng hợp code Clover Knights Thánh Hiệp Sĩ Mới Nhất năm 2023 – Cách nhập mã

Share code

September 6, 2023

Hôm nay, triple-hearts sẽ cung cấp cho bạn danh sách các mã code Clover Knights Thánh Hiệp Sĩ Mới Nhất.…

Bài viết mới nhất về Code Cloud Song mới nhất năm 2023: Hướng dẫn cách nhập code

Share code

September 6, 2023

Gần đây, nhà phát hành VNG đã tung ra một trò chơi phiêu lưu mới có tên Cloud Song: Vân…

Tổng hợp code clash of zombies 2 Mới Nhất năm 2023

Share code

September 6, 2023

Bạn đang tìm kiếm mã code Clash of Zombies 2 mới nhất để nhận được phần thưởng hữu ích trong…

Code clash of warpath wild rift Mới Nhất năm 2023

Share code

September 6, 2023

Hôm nay mình sẽ chia sẻ với các bạn về bộ mã Code clash of warpath wild rift Mới Nhất…

Code clash of minions Mới Nhất năm 2023

Share code

September 6, 2023

Bạn đã sẵn sàng nhận mưa Code clash of minions Mới Nhất chưa? Nhập ngay mã quà tặng mới nhất…

Nhận code Chưởng Thượng Tu Tiên Mới Nhất năm 2023

Share code

September 6, 2023

Với một đồ họa đẹp mắt, chân thực và hơn 100 nhân vật Ninja, Chưởng Thượng Tu Tiên đã tái…